让 AI 直接操控终端程序,这个 MCP 开源项目做到了

一个安全工程师的真实痛点

做过 AI 自动化渗透测试的人大概都体会过一种挫败感:你让 Claude 或 GPT 帮你跑一套完整的渗透流程,到了需要调用 impacket、evil-winrm 这类交互式工具的时候,AI 就卡住了。

原因很简单——这些程序不是"一次性"的命令行工具,它们启动后会持续运行,等待你输入指令、读取输出、再输入下一条指令。这是一个有状态的交互过程。而目前绝大多数 AI Agent 的工具调用模式是无状态的:调一次,拿结果,结束。每次调用都是一个全新的进程,上下文全丢。

这就是开发者 UserB1ank 近日开源 interactive-process-mcp 的直接动机。他在 LINUX DO 社区发帖说得很直白:"与其为每一个程序开发 MCP,不如做一层 IO,把进程包裹起来,让 AI 专注于输入输出。"

思路不复杂,但切中了一个真实且普遍的需求。

它到底解决了什么问题?

要理解这个项目的价值,得先搞清楚 AI Agent 操作终端程序时面临的几个核心矛盾。

矛盾一:无状态调用 vs 有状态进程

大多数 MCP 工具的设计思路是函数式的——你传参数进去,它返回结果。像 ls -la 这种命令完美适配这个模式。但 python3 解释器呢?mysql 客户端呢?ssh 会话呢?这些程序启动后就进入了一个持续的交互循环,你需要在同一个进程里反复读写。

传统做法是每次 AI 需要执行操作时,都新起一个进程。这意味着之前建立的连接、登录的会话、设置的环境变量——全没了。对于渗透测试这种高度依赖上下文连续性的场景,这基本等于不可用。

矛盾二:单一工具 vs 多样生态

安全领域有几百个常用工具,每个工具的交互模式都不一样。如果要让 AI 能用这些工具,传统路径是为每个工具写一个专门的 MCP Server。这个工作量是天文数字,而且永远跟不上工具生态的更新速度。

矛盾三:AI 的理解能力 vs 工具的复杂性

现在的大模型其实已经"认识"绝大多数命令行工具了——它知道 nmap 怎么用,知道 Metasploit 的命令语法。缺的不是知识,是操作通道。AI 有手,但手够不到键盘。

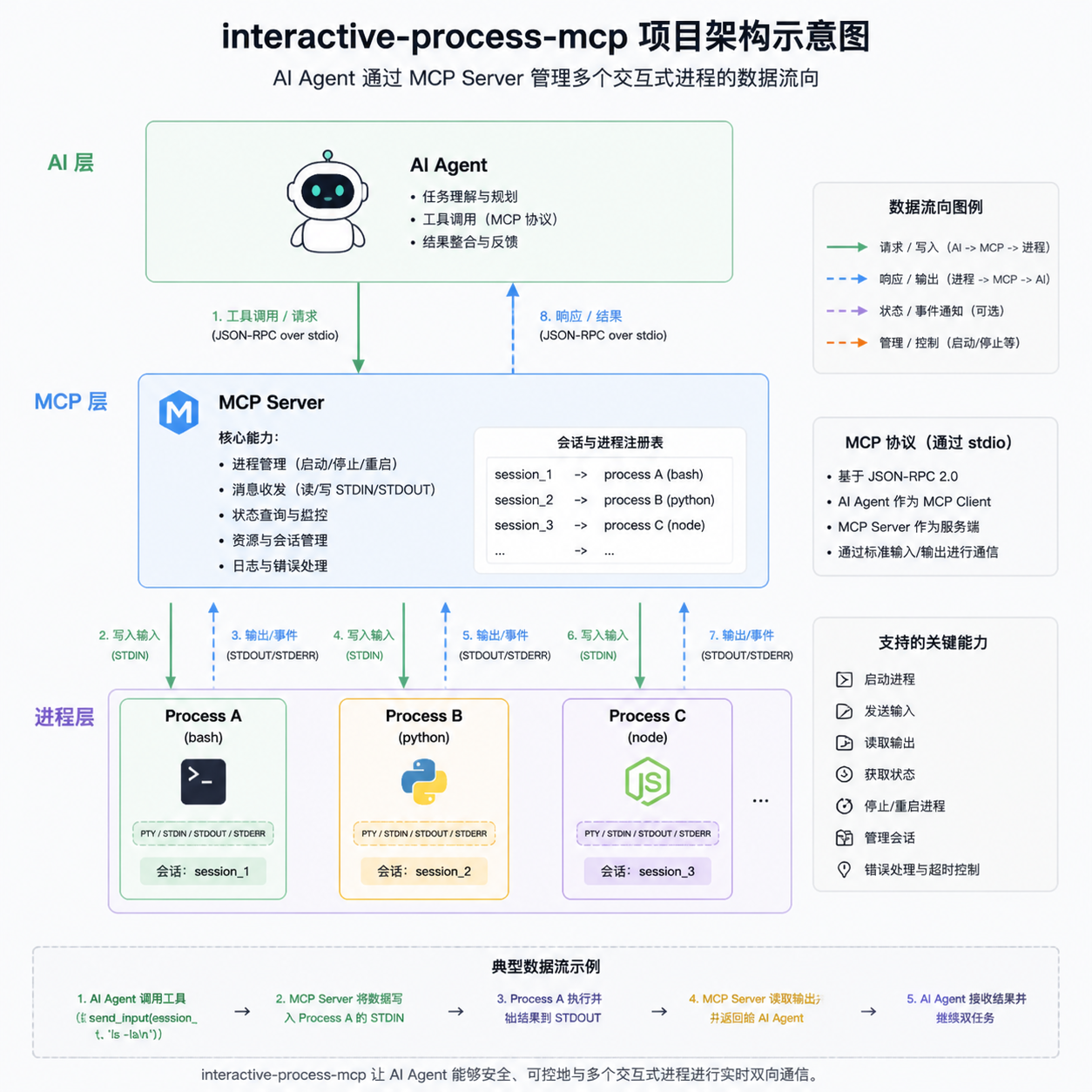

interactive-process-mcp 的解法是在 AI 和终端之间加一个通用的中间层:一个基于 MCP 协议的进程管理器。它不关心你要操作的是什么程序,它只负责三件事:启动进程、转发输入输出、维护会话状态。

技术实现:怎么做的?

项目的核心设计可以用一句话概括:把交互式进程的 stdin/stdout/stderr 抽象成 MCP 工具调用接口。

具体来看,interactive-process-mcp 提供了以下几个关键能力:

1. 进程生命周期管理

AI Agent 可以通过 MCP 工具调用来启动一个新的交互式进程,比如:

- 启动一个 Python 解释器

- 打开一个 SSH 连接

- 运行 impacket 的 psexec.py

- 启动 evil-winrm 会话

关键在于,这些进程启动后不会立即退出。它们会被 MCP Server 持有,保持运行状态,等待后续的输入。

2. 输入输出转发

一旦进程启动,AI 可以:

- 向进程的 stdin 发送命令

- 读取进程的 stdout/stderr 输出

- 根据输出内容决定下一步操作

这就形成了一个完整的交互循环。AI 不再是"盲射"命令,而是能看到每一步的执行结果,像人类操作终端一样做出判断。

3. 多进程并发管理

实际的渗透测试或运维场景中,你经常需要同时维护多个会话——一个 SSH 连接到目标机器,一个本地的监听器,一个数据库客户端。interactive-process-mcp 支持同时管理多个进程,每个进程有独立的标识符,AI 可以在不同进程间切换操作。

4. 会话持久化

这是最关键的一点。传统的命令执行方式下,每次调用都是一个新进程。而 interactive-process-mcp 维护的是长生命周期的进程会话。你在 MySQL 客户端里 USE database; 之后,下一条 SELECT 语句还是在同一个会话里,数据库上下文不会丢失。

从架构上看,这个项目的定位非常清晰:

┌─────────────┐ MCP Protocol ┌──────────────────────┐

│ AI Agent │ ◄──────────────────► │ interactive-process │

│ (Claude等) │ │ MCP Server │

└─────────────┘ └──────────┬───────────┘

│

┌───────────┼───────────┐

│ │ │

▼ ▼ ▼

┌──────┐ ┌──────┐ ┌──────┐

│ ssh │ │ mysql│ │python│

│会话1 │ │会话2 │ │会话3 │

└──────┘ └──────┘ └──────┘

AI Agent 通过标准的 MCP 协议与 Server 通信,Server 负责管理底层的多个交互式进程。对 AI 来说,操作任何程序的方式都是一样的:发送输入、读取输出。

为什么是 MCP?

如果你最近半年关注 AI Agent 生态,MCP(Model Context Protocol)这个词一定不陌生。

MCP 由 Anthropic 在 2024 年底提出,被业界形象地称为"AI 的 USB-C"。它的核心目标是提供一个标准化的协议,让 AI Agent 能以统一的方式连接各种外部工具和数据源。就像 USB-C 让你的笔记本电脑能用同一个接口连接显示器、硬盘、充电器一样,MCP 让 AI Agent 能用同一套协议调用数据库查询、文件操作、API 调用等各种能力。

到 2025 年,MCP 已经获得了广泛的行业认可。不仅 Anthropic 自家的 Claude 全面支持,OpenAI 也加入了 MCP 阵营。LangChain、CrewAI、AutoGen 等主流 Agent 框架都已集成 MCP 支持。今年早些时候,OpenAI 和 Anthropic 甚至联合推出了 MCP Apps 提案(SEP-1865),要把 MCP 从纯文本交互升级到支持可视化界面。

选择 MCP 作为协议层,意味着 interactive-process-mcp 天然兼容所有支持 MCP 的 AI 客户端。你可以在 Claude Code 里用它,可以在 Cursor 里用它,也可以在任何自建的 LangChain Agent 里用它。这种兼容性不是项目自己做的,而是协议标准化带来的红利。

实际应用场景

虽然这个项目的作者是从安全测试的角度出发的,但它的适用范围远不止于此。

场景一:自动化渗透测试

这是最直接的场景。AI Agent 可以:

- 启动 nmap 进行端口扫描

- 根据扫描结果,启动对应的漏洞利用工具

- 在获取的 shell 中执行后续操作

- 全程保持会话连续性

以前你需要人坐在终端前一步步操作,现在 AI 可以自主完成整个链条。当然,这里有明显的安全伦理问题——这个工具显然应该只用于授权的安全测试。

场景二:交互式调试

AI 辅助编程已经很常见了,但目前大多停留在"写代码"层面。有了交互式进程管理,AI 可以:

- 启动 Python/Node.js 的 REPL 环境

- 逐步执行代码,观察中间状态

- 根据运行结果调整策略

- 在调试器(如 gdb、pdb)中设置断点、检查变量

这比单纯的代码生成要深入得多。AI 不再只是给你写代码,它可以帮你跑代码、看结果、定位问题。

场景三:数据库交互式查询

连接到 MySQL、PostgreSQL 或 Redis 客户端后,AI 可以在同一个会话中执行一系列关联查询,而不是每次都重新建立连接。这对于复杂的数据分析任务来说是基本需求。

场景四:运维自动化

通过 SSH 会话管理远程服务器、在交互式配置向导中自动填写参数、操作需要多步确认的系统管理工具——这些都是运维中的常见场景,也是传统 AI 工具调用模式的盲区。

场景五:教学与演示

AI 可以在交互式环境中一步步演示操作过程,每一步都有真实的输出反馈,比纯文本教程生动得多。

跟现有方案比怎么样?

目前市面上处理 AI 与终端交互的方案大致有几类:

方案一:为每个工具单独开发 MCP Server。 比如已经有人做了 Git MCP Server、Docker MCP Server 等。优点是针对性强,缺点是覆盖面有限,维护成本高。interactive-process-mcp 的思路是反过来的——我不管你是什么工具,我只管 IO。

方案二:通过 shell 命令执行。 很多 Agent 框架支持执行 shell 命令,但基本都是一次性的 exec。没有会话持久化,没有交互能力。适合简单命令,搞不定复杂场景。

方案三:Kali MCP 等专用方案。 这类项目通常预定义了一组安全工具的调用方式,但灵活性受限于预定义的工具列表。新工具出来了,你得等项目更新。

interactive-process-mcp 的优势在于它的通用性。它不绑定任何特定工具,理论上任何能在终端里运行的交互式程序都可以通过它来操控。这种"不做具体事,只做管道"的设计哲学,往往比"大而全"的方案更有生命力。

当然,通用性也意味着它不会针对特定工具做优化。比如你用它操作 Metasploit,AI 需要自己理解 Metasploit 的输出格式和命令语法。好在现在的大模型对这些主流工具的理解已经相当到位了。

值得关注的问题

说完优点,也得聊聊这个项目目前的局限和需要注意的地方。

安全风险

这是最显而易见的问题。让 AI Agent 拥有操控终端进程的能力,等于给了它一把钥匙。如果 AI 的判断出了偏差,或者 prompt 被注入了恶意指令,后果可能比单纯的代码生成错误严重得多——毕竟这里执行的是真实的系统操作。

在生产环境使用这类工具,必须有完善的权限控制和操作审计机制。目前项目还处于早期阶段,这方面的防护措施还需要社区共同完善。

输出解析的挑战

交互式程序的输出千变万化——有颜色代码、有进度条、有表格、有二进制数据。AI 需要从这些"脏"输出中提取有意义的信息。这对大模型的理解能力提出了不低的要求。特别是一些工具的输出中包含 ANSI 转义序列,如果不做处理,AI 可能会被这些控制字符搞糊涂。

超时和异常处理

交互式进程可能会挂起、崩溃、或者等待一个永远不会到来的输入。MCP Server 需要有健壮的超时机制和异常恢复能力。这在实际使用中是绕不开的工程问题。

项目成熟度

作为一个刚开源的个人项目,interactive-process-mcp 的代码量和社区活跃度还处于起步阶段。在 LINUX DO 上的帖子也是最近才发布的。如果你打算在正式项目中使用,建议先在隔离环境中充分测试。

更大的图景

把视角拉远一点看,interactive-process-mcp 代表的是 AI Agent 能力边界扩展的一个方向:从调用 API 到操控进程。

2024 年到 2025 年,AI Agent 的工具使用能力经历了快速进化。最早是简单的函数调用(Function Calling),然后是通过 MCP 等协议连接标准化的工具服务,再到现在开始尝试操控真实的系统进程。每一步都让 AI 能做的事情更多、更接近人类的操作方式。

这个趋势的终点是什么?大概是 AI Agent 能像一个熟练的工程师一样,坐在终端前,根据需要启动各种工具,在不同的会话间切换,根据实时反馈调整策略。interactive-process-mcp 做的事情,就是在这条路上往前推了一步。

值得一提的是,这个项目也体现了开源社区的一个有趣现象:真正有用的工具往往来自一线实践者的"突发奇想"。作者在 LINUX DO 上说这是"最近突发奇想做的项目",但这个"突发奇想"背后是真实的工作痛点和对问题本质的准确把握。

对于 AI Agent 开发者来说,interactive-process-mcp 至少提供了一个值得参考的思路:不要试图为每个工具做适配,而是做一个通用的交互层。这个思路在其他领域也适用——比如让 AI 操作 GUI 程序、操作硬件设备等等。

怎么上手?

如果你想试试这个项目,可以直接去 GitHub 仓库克隆代码:

git clone https://github.com/UserB1ank/interactive-process-mcp.git

项目基于 MCP 协议实现,理论上兼容所有支持 MCP 的 AI 客户端。目前最方便的体验方式是配合 Claude Code 使用——在 MCP 配置中添加这个 Server,然后你就可以让 Claude 帮你操作各种交互式终端程序了。

具体的配置方式和使用示例,建议参考项目的 README 文档。作为一个新项目,文档可能还在完善中,但核心功能的使用应该已经比较清晰了。

编辑点评: 这是一个小而精的项目,解决的是一个被很多人忽视但确实存在的问题。它不会改变 AI Agent 的底层范式,但它填补了一个重要的能力缺口。如果你的工作涉及 AI 自动化运维、安全测试、或者任何需要 AI 操控交互式程序的场景,这个项目值得关注。MCP 生态正在快速膨胀,这类"小工具、大价值"的项目会越来越多。

参考来源

- interactive-process-mcp GitHub 仓库 — 项目源代码及文档

- LINUX DO 社区原帖:给予 Agent 操作交互式进程的能力 — 作者项目介绍及开发动机

- MCP 构建更智能、模块化 AI 代理的通用连接器 — 知乎 — MCP 协议深度解析及框架集成情况