5 月 5 日,OpenAI 把 ChatGPT 的默认模型从 GPT-5.3 Instant 换成了 GPT-5.5 Instant。这是继 4 月 23 日 GPT-5.5(代号 Spud)和 GPT-5.5 Pro 登场之后,5.5 家族的第三块拼图,也是大多数 ChatGPT 用户真正会天天碰到的那一块——毕竟只有付费用户会主动去选 Thinking 或 Pro,免费用户打开对话框得到的就是 Instant。

这次升级的关键词只有一个:少胡说。

幻觉率砍掉一半,但只砍在刀刃上

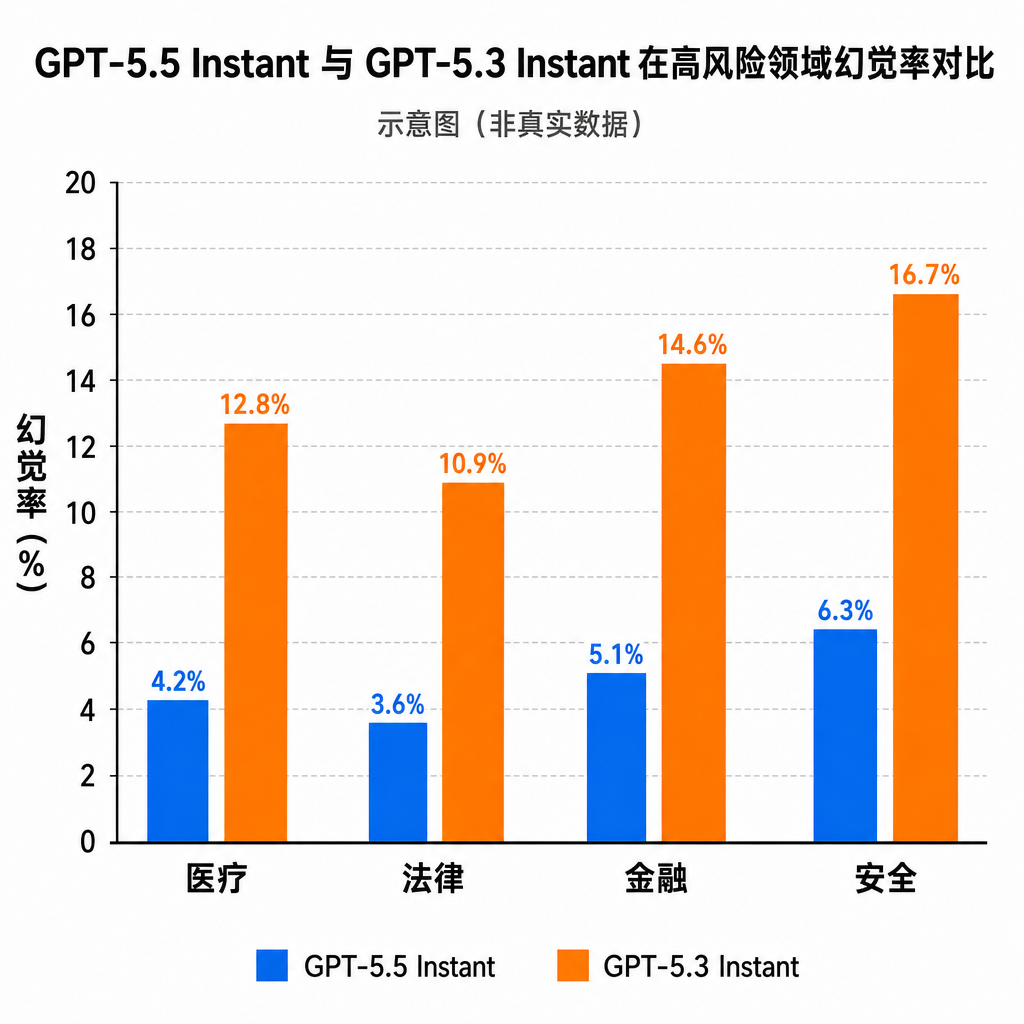

OpenAI 给出的内部评测数据挺扎眼:在医学、法律、金融这类高风险领域的 prompt 上,GPT-5.5 Instant 相比 GPT-5.3 Instant,幻觉声明减少了 52.5%;在用户主动标记过「这答案不对」的困难对话里,不准确陈述减少了 37.3%。

注意这两个数字的语境——不是泛泛的 benchmark 刷分,而是 OpenAI 自己挑出来的「容易翻车」场景。换句话说,他们承认过去 Instant 在这些地方翻得最多,现在专门修。

这个方向其实和整个 5.5 家族的调性一致。GPT-5.5 发布时 OpenAI 着重讲的也是事实性和推理深度,不是参数或上下文长度。过去一年从 5.2 到 5.4,OpenAI 把更多精力从「让模型更聪明」转到「让模型更可信」——对 ToB 场景来说这比多几个点的 MMLU 重要得多。一个会在合同条款上编法条的模型,律所是不会碰的。

当然,52.5% 这种来自厂商自评的数字要打个折看。The Verge 的报道里也特地强调了「基于内部评估」这个限定语。真实世界的验证得等第三方跑完 SimpleQA、LongFact 这类专门的事实性基准之后才算数。但从用户侧的直观体感讲,这代 Instant 确实更「惜字」了——不该说的它不再硬答,碰到不确定的更倾向于说「我不确定」。

输出更紧、格式更干净

除了事实性,GPT-5.5 Instant 在视觉推理、数学和科学任务上都有提升,但 OpenAI 自己更强调的是一个很微妙的改动:回答变短了。

用过 GPT-5.3 Instant 的人应该有感觉,那代模型有种「强迫症式排版」的毛病——不管你问什么,它都要先列三个 bullet point,再分两个 section,末尾还来一个「希望这对你有帮助」的尾巴。问一个简单的「Python 里 list 和 tuple 有什么区别」,能给你甩出两屏 Markdown。

GPT-5.5 Instant 把这个冗余度压下来了。OpenAI 的说法是「减少冗余和过度格式化」,翻译一下就是:该用一句话回答的别扯出一篇文档。对开发者来说这是实打实的好消息——套在 Agent 或者 RAG 流程里的时候,无意义的格式 token 就是在烧钱。

个性化和记忆源控件

另一块升级是上下文利用能力。GPT-5.5 Instant 更擅长从历史对话、上传文件、以及连接的 Gmail 里抽取相关信息来回答。这个能力先开放给 Plus 和 Pro,后面会铺到其他套餐。

伴随而来的是一个叫**记忆源控件(memory source controls)**的新功能——用户可以查看哪些上下文被用来个性化回答,也可以手动关掉。这算是对过去一年记忆功能争议的一次正面回应。ChatGPT 的记忆功能一直处在「用起来挺爽、但细想有点慌」的状态,现在至少有个可视化的开关,让你知道模型「记住」了什么。

从产品设计角度看,OpenAI 这步走得比较稳。过去记忆是黑盒,现在把盒子拆开给你看——这和 Anthropic 最近在 Claude 里推的对话上下文审计走的是同一个思路,两边都意识到企业客户和注重隐私的个人用户不会接受一个「替你想好了」但说不清凭什么想的 AI。

API 侧:chat-latest 的含义

对开发者来说,更有价值的消息是 GPT-5.5 Instant 同步开放 API,模型标识是 chat-latest。

这个命名方式要展开说两句。OpenAI 的 API 模型名一直有两种风格:一种是版本锁定的(比如 gpt-5.5-2026-04-23),一种是别名滚动的(比如 chat-latest)。chat-latest 指向的永远是当前 ChatGPT 产品线使用的 Instant 模型——今天是 GPT-5.5 Instant,下次小升级它就自动指向新版本。

这个别名对两类场景特别合适:一是你想让线上应用和 ChatGPT 体验保持同步,二是你不想每次 OpenAI 推新就手动改模型名。但要注意的是,生产环境如果对一致性有严格要求,还是应该锁定具体版本号,chat-latest 的行为会在没有通知的情况下变化。

下面是一个通过 OpenAI Hub 调用 GPT-5.5 Instant 的最小示例。OpenAI Hub 是国内可以直连的 AI API 聚合平台,一个 Key 同时能调 GPT、Claude、Gemini、DeepSeek 等主流模型,接口完全兼容 OpenAI 官方格式:

from openai import OpenAI

client = OpenAI(

api_key="your-openai-hub-key",

base_url="https://api.openai-hub.com/v1"

)

response = client.chat.completions.create(

model="chat-latest", # 等价于当前 GPT-5.5 Instant

messages=[

{"role": "system", "content": "你是一个严谨的医学文献助手,回答时必须标注不确定性。"},

{"role": "user", "content": "二甲双胍与 SGLT2 抑制剂联用在 eGFR 30-45 区间的证据等级?"}

],

temperature=0.2

)

print(response.choices[0].message.content)

如果你想锁死具体版本,把 model 换成官方给出的日期版本号就行。国内直连这点对很多团队省心,不用单独给 OpenAI 留一条出境通道。

GPT-5.3 Instant 的三个月缓冲

OpenAI 这次没有一刀切,付费用户可以在接下来三个月继续在模型选择器里用到 GPT-5.3 Instant。这个过渡期设计对依赖特定模型输出特性的用户挺关键——尤其是做了细致 prompt tuning 的团队,模型切换往往意味着提示词要重写一轮。

但从 OpenAI 过去两年的操作节奏看,三个月就是三个月。到了 8 月初,GPT-5.3 Instant 基本上就要从 ChatGPT 界面消失(API 端一般会保留更长时间)。有历史包袱的项目,这段时间得抓紧做迁移测试。

放到 5.5 家族里看

把视角拉远一点。GPT-5.5 家族现在的层级是这样的:

- GPT-5.5 Pro:最强,$30/$180 每百万 tokens,面向复杂推理和长链路任务

- GPT-5.5(Thinking):标准版,$5/$30 每百万 tokens,是 GPT-5.4 价格的 2 倍

- GPT-5.5 Instant:今天上线,低延迟版本,默认承接 ChatGPT 主流量

这个分层和 Anthropic 的 Opus/Sonnet/Haiku、Google 的 Pro/Flash 思路一致,但 OpenAI 的定价更激进——GPT-5.5 标准版比 5.4 直接翻倍,和 Claude Opus 4.7 的 input 价格打平、output 还贵了 20%。相比之下 Gemini 3.1 Pro 在 200K context 以下便宜 60%。OpenAI 显然认为自己的能力溢价撑得住这个价,而 Google 还在用价格换市场。

Instant 这一档的 API 定价目前还没明确公布(官方文档仍在更新),但按照以往规律,Instant 会显著便宜于标准版,大概率延续 GPT-5.3 Instant 的价位甚至略降。如果这点能兑现,对大部分日常客服、内容生成、轻量 Agent 场景来说,GPT-5.5 Instant 会是性价比最合适的一档——既享受了新一代的事实性提升,又不用承担 Thinking 模式的推理成本。

写在最后

GPT-5.5 Instant 不是那种会上头条的发布——它没有炸裂的新能力,没有跨越式 benchmark,甚至都不是一次独立发布,而是 4 月 23 日 GPT-5.5 主线的自然延伸。但它影响的用户基数是最大的:每一个打开 ChatGPT 却从不去切模型的人,从今天起用的就是这个。

所以「幻觉减少一半」这件事的价值,不在于刷新了什么数字,而在于它发生在默认路径上。AI 工具之所以还没有真正进入医生、律师、财务顾问的日常工作流,很大一部分原因就是默认模型不够可靠——你不能指望一个医生在每次问询前先手动切到「更准确的那一档」。OpenAI 把可靠性放进默认选项,这一步走对了。

至于真实效果,还是那句话,等第三方评测和一线开发者用出花样来再下定论。对想第一时间上手的团队,直接在 OpenAI Hub 用 chat-latest 调起来就行,API 端已经同步可用。

参考来源

- LINUX DO - OpenAI 将 ChatGPT 默认模型更新为 GPT-5.5 Instant:发布当天的中文社区讨论,含官方内部评测数据的整理

- 知乎 - OpenAI 发布 GPT-5.5 和 GPT-5.5 Pro 模型:GPT-5.5 家族发布时的中文报道,含各套餐开放节奏说明