苹果要让用户自己挑 AI 了。

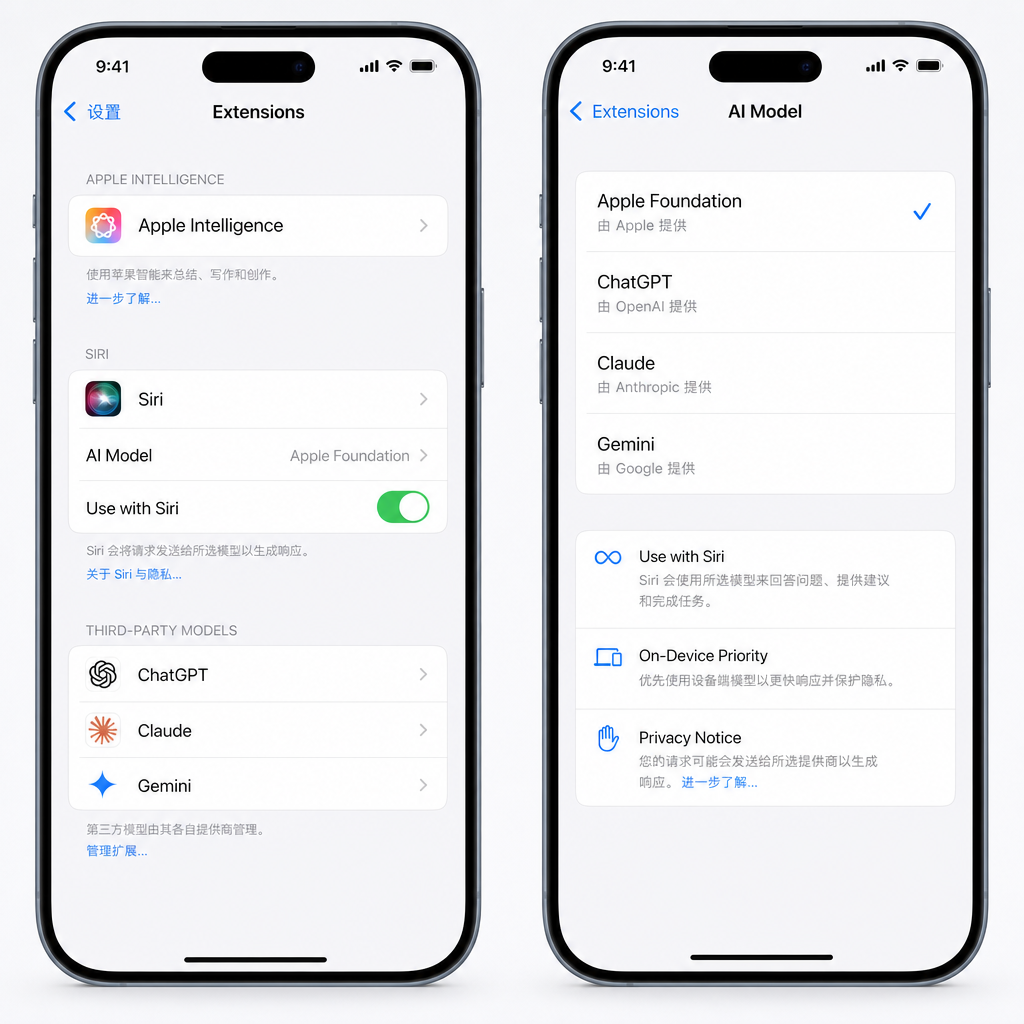

据彭博社 Mark Gurman 本周披露、TechCrunch 与 The Verge 同步跟进的报道,苹果计划在今年秋季发布的 iOS 27、iPadOS 27 和 macOS 27 中,引入一套名为 Extensions 的第三方 AI 扩展机制。简单说,用户可以自行决定由哪家大模型来驱动 Siri,以及 Apple Intelligence 下的写作工具(Writing Tools)、图像生成(Image Playground)等一整套系统级 AI 功能。这是苹果第一次在操作系统层面,把 AI 这块地交给外人来种。

从独家到开放,苹果的态度变了

回看时间线,这件事的转向其实有迹可循。

iOS 18 上线 Apple Intelligence 时,苹果选择了 OpenAI 作为唯一的外部合作伙伴,Siri 遇到复杂问题会把请求转交给 ChatGPT。当时业界的普遍解读是:苹果自研大模型进度不够,先借一把 OpenAI 的力,属于过渡方案。到了 iOS 26,苹果给 CarPlay 开了个小口子,允许第三方 AI 聊天机器人接入——但仅限车机场景,象征意义大于实际。

现在 iOS 27 要做的事情完全不一样。它不是多加一个合作伙伴,而是把 AI 模型的选择权整个交出去。按 Gurman 的说法,用户安装 Claude 或 Gemini 的 App 后,系统设置里会出现一个入口,直接选「谁来当 Siri 的大脑」;没装的,系统还会预置 App Store 的跳转链接,一键安装。

这个姿态很苹果,也很不苹果。苹果的部分是,它依然牢牢控制着入口、交互和分发;不苹果的部分是,核心智能层这次真的放手了。

Extensions 到底能做什么

根据目前流出的测试版信息,Extensions 覆盖的能力范围比大多数人预期的要大。三件事值得单独拎出来说:

第一,Siri 全面可替换。 不只是「听不懂就转交」的兜底模式,而是 Siri 的回答本体就可以由第三方模型生成。你问天气、订日程这些系统任务还是苹果自己处理,但开放性对话、复杂推理、长文本理解这些事,可以完全走 Claude 或 Gemini 的通道。

第二,写作工具和 Image Playground 也开放了。 这是比 Siri 更有意思的变化。写作工具在 iOS 18/26 时代是 Apple Intelligence 的主打功能,润色、改写、摘要全都跑在苹果自家模型上。现在这些入口可以切到 Claude——熟悉 Claude 写作风格的人应该知道这意味着什么。Image Playground 一直被吐槽生成质量拉胯,接入 Gemini 或其他图像模型后,至少有了救的可能。

第三,不同模型可以配不同 Siri 声音。 这个细节很少被提到,但挺有意思:你可以给 Claude 配一个声音,给 Gemini 配另一个,切换模型时连音色都跟着换。对开发者来说,这是个明显的信号——苹果在把「AI 人格」作为一等公民来设计。

另外据 9to5Mac 报道,苹果内部还在测试一个代号 Campo 的独立 Siri App,定位类似 ChatGPT 那种专门的聊天界面,同样支持 Extensions 体系。这等于承认了一件事:Siri 原来那种「长按 Home/侧键」的短交互,已经不够用了。

底层合作没变,Gemini 仍是基石

有个容易被忽略的事实:开放 Extensions 并不影响苹果和谷歌此前谈妥的底层合作。Gemini 模型仍将继续驱动 Apple Intelligence 的核心能力,尤其是设备端无法处理、需要走云端的那部分重型推理。

换句话说,iOS 27 的 AI 架构其实是分层的:

- 端侧小模型:苹果自研,处理隐私敏感、低延迟任务

- 云端基础层:Gemini 托底,处理通用复杂任务

- 用户可选扩展层:Claude、ChatGPT、以及未来任何愿意适配的模型,处理用户指定的场景

这个结构挺聪明的。苹果保住了「隐私优先」的叙事(端侧),锁定了一个稳定的兜底(Gemini),又把选择权交给用户(Extensions)。三层各司其职,互不打架。

谁是赢家,谁是输家

这一步棋,受益最大的是 Anthropic。

Claude 过去一年在开发者圈的口碑涨得很凶,尤其是代码能力和长文本处理,但它始终缺一个面向普通消费者的大流量入口。iOS 27 这扇门一开,Claude 第一次能站在全球十几亿台 iPhone 的系统级 AI 入口前。对 Anthropic 来说,这比融多少轮都重要。

谷歌是另一个赢家,但方式不同。它同时占着两个位置:作为 Apple Intelligence 的底层供应商拿走一大块确定性收入,又作为 Extensions 里的一个可选项参与用户争夺。双保险。

相对尴尬的反而是 OpenAI。从 iOS 18 的独家合作伙伴,变成 iOS 27 里「选项之一」,身位明显回撤。ChatGPT 当然还是最有品牌认知的那个,但独家红利没了,用户流失到 Claude 或 Gemini 的摩擦成本,被苹果降到了最低——设置里点一下就行。

国内的大模型厂商在这轮里暂时没戏。Extensions 大概率会沿用 App Store 的地区策略,国区 iOS 27 能不能看到 Claude 和 Gemini 的入口本身就是个问号,更别说本土模型的接入。不过这事反过来也说明,国内开发者想在海外 iPhone 上分发 AI 能力,Extensions 是一个值得提前研究的新通道。

对开发者意味着什么

如果 Gurman 的爆料准确,WWDC26(预计 6 月 8 日)上苹果会公布 Extensions 的完整开发规范。目前已经能推断的几点:

- 接入方式大概率是类似 App Intents 的声明式 API,模型厂商用自己的 App 作为壳,把能力注册给系统

- 用户身份和调用额度由模型厂商自己管,苹果只做路由,不做计费中转

- 隐私边界会是审核重点,哪些数据可以传给第三方模型、哪些必须留在设备上,苹果会划得很细

对独立开发者来说,短期内能做的事不多——Extensions 的门槛只对大模型厂商开放,不是随便一个 App 都能去「当 Siri」。但长期看,这套机制一旦成熟,很可能扩展到垂直领域:比如专门处理法律问题的模型、专门做代码的模型,各自占据不同的场景入口。

一个更大的问题:苹果自研怎么办

把 AI 核心能力交给第三方,意味着苹果变相承认了一件事:在基础大模型这条赛道上,它没追上,而且短期内也追不上。

这不是坏事。硬件、系统、分发渠道才是苹果真正的壁垒,把模型层当作可替换的组件,反而让它的护城河更干净。类似的事苹果做过不止一次——地图是 Google Maps 的底,搜索是 Google Search 的底,现在 AI 也走同一条路。

但这里面有个隐忧。当用户对「AI 能力」的感知越来越等同于「某个具体模型」,而不是「iPhone 本身」时,苹果在 AI 叙事上的话语权会被稀释。用户会说「我用 Claude」,而不是「我用 iPhone 的 AI」。这对一个靠品牌溢价吃饭的公司,不完全是好消息。

苹果显然也意识到了这点,所以 Extensions 的设计里藏着一些防御性动作:Siri 的交互外壳、声音、调用时机全部由系统控制,第三方模型只是后端。用户切换模型的动作越简单,对苹果越有利——因为这证明了「壳」才是关键,而壳是苹果的。

时间表

按目前的信息整理一下关键节点:

- 2026 年 6 月 8 日:WWDC26,苹果正式公布 iOS 27、iPadOS 27、macOS 27,Extensions 开发者文档同步开放

- 2026 年夏季:开发者测试版、公开测试版陆续推送,第一批接入的模型很可能是 Claude 和 Gemini

- 2026 年秋季:正式版发布,跟随新一代 iPhone 上市

- Campo 独立 Siri App:具体时间未定,可能随正式版一起,也可能延后到 iOS 27.x

对于需要在海外市场调用多家主流模型做产品验证的团队,OpenAI Hub 目前已经支持 Claude、Gemini、GPT、DeepSeek 等主流模型的统一调用,一个 Key 走完所有兼容 OpenAI 格式的接口,在苹果正式开放 Extensions 之前,可以先用它把多模型切换的产品形态验证跑通。

写在最后

iOS 27 这一步,本质上是苹果对「AI 时代操作系统该长什么样」给出的第一个认真回答。不是自己做一个最强模型,而是做一个最好的模型容器。这个思路不新——浏览器时代、应用商店时代苹果都这么做过——但用在 AI 上还是第一次。

好不好,要等 WWDC 看实现细节。但至少从现在的信息看,苹果想明白了一件事:用户不关心 AI 是谁做的,用户只关心它好不好用、切换方不方便。把这两件事做到极致,操作系统厂商在 AI 时代依然有位置。

这可能比任何一个自研模型的 Benchmark 分数都更重要。