马斯克把自家旧旗舰,租给了直接对手

当地时间 5 月 6 日,Anthropic 和 SpaceX 同时发公告,签下一份算力协议:Anthropic 拿到 Colossus 1 数据中心的全部容量,本月内就能部署上线。紧接着 Anthropic 官方宣布,Claude 付费用户的使用上限即日起全面上调。

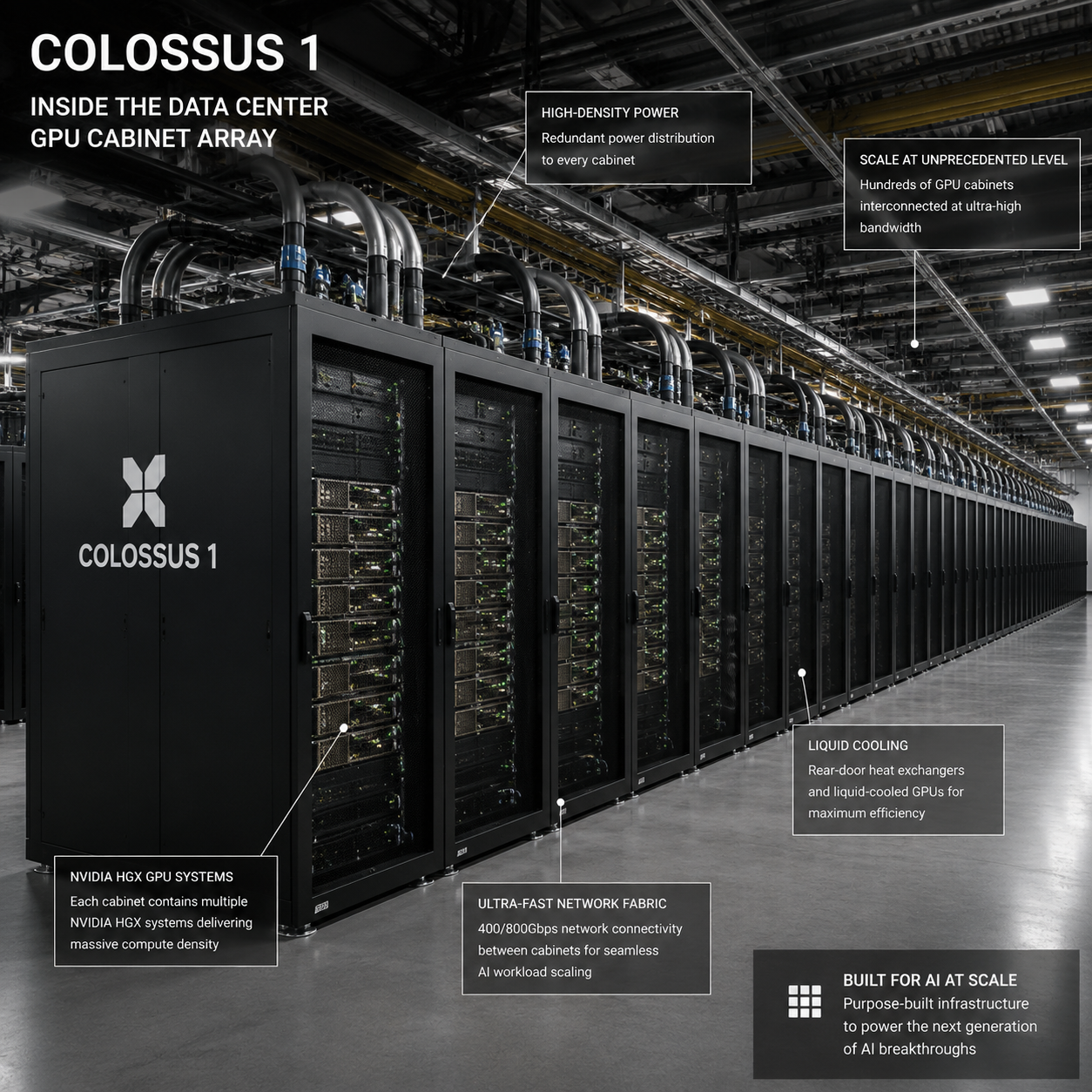

这事如果只看合作方名字,是 Anthropic 和 SpaceX 的一次算力采购。但把背景拼起来就有意思了——Colossus 1 是位于田纳西州孟菲斯的那座超级计算机,原本是 xAI 训练 Grok 的主力机,超过 22 万张 NVIDIA GPU,功耗 300 兆瓦以上。今年 2 月 2 日 SpaceX 以全股票方式完成对 xAI 的收购,合并估值 1.25 万亿美元,Colossus 1 随之归到 SpaceX 名下。

换句话说,马斯克把自家 xAI 的旧旗舰,整座租给了直接对手 Anthropic 跑 Claude。按外界估算,22 万张 GPU 接近 xAI 整个 50 万张 GPU 队伍的一半。xAI 之所以能让出,是因为训练重心已经转移到了今年 1 月上线的 Colossus 2——那是千兆瓦级别的新旗舰。

AI 行业的戏剧性就是这样:旧算力折旧得很快,却依然是别人手里的稀缺资源。

具体翻了哪些限额

Anthropic 把这次容量扩张直接折算成了用户可感的额度提升,三项变化今天即生效:

- Claude Code 五小时滚动限额翻倍:Pro、Max、Team 以及按席位计费的 Enterprise 方案全部适用。原本 Pro 用户一个窗口能跑的 tokens 量基本够中等规模 agent 任务,现在相当于每个周期多出一倍的"耐力"。

- 取消 Pro 和 Max 高峰时段降速:过去在北美白天高峰时段,这两个档位会被后台压低可用额度,体感上就是一不小心就撞限。这个降速机制从今天起整个取消。

- Opus API 速率限制大幅上调:这是对开发者最实质的利好。Opus 作为 Claude 最强档位,原本的 RPM 和 TPM 对长上下文、多轮 agent 编排场景一直是瓶颈,这次调整后企业级接入的压力会明显小一截。

Anthropic 没有给出具体的百分比数字,但从 Claude Code 重度用户在 Linux.do、Reddit 的反馈看,过去几个月"撞墙"抱怨最多的就是 5 小时窗口——尤其是跑 Claude Code 做大仓库重构、或者接 SWE-bench 这类任务时,经常一个 PR 没跑完就触发限速。这次翻倍不是锦上添花,是从"基本可用"拉到"放开手脚"的临界提升。

对开发者意味着什么

对用 API 的团队,最该关注的是 Opus 这条线。Opus 在代码 agent、长文档分析、复杂推理这几类任务上定位很清晰,但之前不少团队实际接入时发现"模型能力够,限额先拦住"。典型情况是跑一个 24 小时滚动的 agent worker 池,几台并发一起去调 Opus,分分钟触发 429。

上调之后,原来需要做的 token bucket、重试退避、多 key 轮询这些工程绕行手段,压力会小很多。当然也不会消失,只是从"架构必须围绕限额设计"降级为"按正常峰值规划容量"。

如果你是走 OpenAI Hub 这类聚合平台接 Claude 的,这波调整会直接体现在上游转发容量上。OpenAI Hub 已经同步跟进了 Anthropic 侧的新限额,一个 Key 调 Claude Opus / Sonnet / Haiku 全系,兼容 OpenAI 格式,国内直连不用翻墙。调用方式还是老样子:

from openai import OpenAI

client = OpenAI(

api_key=\"your-openai-hub-key\",

base_url=\"https://api.openai-hub.com/v1\"

)

response = client.chat.completions.create(

model=\"claude-opus-4\",

messages=[

{\"role\": \"system\", \"content\": \"You are a senior backend engineer.\"},

{\"role\": \"user\", \"content\": \"帮我重构这个 Go 服务的错误处理逻辑,优先考虑可观测性。\"}

],

max_tokens=4096,

temperature=0.2

)

print(response.choices[0].message.content)

对走 Claude Code 订阅的个人开发者就更直接了,不用改任何配置,登录后额度自动翻倍,高峰时段那个恼人的降速提示也该消失了。

顺手提了一句太空

公告里藏了一句容易被忽略的话:Anthropic 表示"有兴趣和 SpaceX 共同开发数千兆瓦级别的轨道 AI 算力",把数据中心送上太空。

这原本是马斯克的剧本——SpaceX 已经向 FCC 申请部署最多 100 万颗作为数据中心的卫星,用在轨太阳能直接供能,真空散热绕开地球上水电双缺的问题。但过去一年多,这条叙事基本只在马斯克一个人嘴里。

现在 Anthropic 主动接住,含义就变了。这不再是 SpaceX 单方面的科幻宣言,而是至少有一家头部 AI 实验室愿意一起下场、签合作备忘。轨道数据中心短期内肯定不现实——热控、辐射硬化、运维、延迟都是硬问题——但在"未来十年算力瓶颈怎么破"这个议题上,它第一次有了两个玩家背书。

值得玩味的是,Anthropic 和马斯克在 AI 安全这件事上曾经隔空交锋过多次。如今因为算力这个最朴素的理由坐到了一张桌子上,商业的引力永远比立场大。

Anthropic 的算力狂奔

今天这单只是 Anthropic 最近一连串算力大单里的一环。把时间线拉开看:

- 和 Amazon 的合作上限达 5 GW,其中近 1 GW 将在 2026 年底前上线,基于 Trainium 芯片

- 和 Google、Broadcom 的合作同样是 5 GW,2027 年起基于 TPU 部署

- 和 Microsoft、NVIDIA 的战略合作里包含 300 亿美元的 Azure 算力承诺

- 和 Fluidstack 一起向美国 AI 基础设施投入 500 亿美元

- 现在再加上 SpaceX 的 Colossus 1 全部容量,以及共同研发轨道算力的意向

把这些加起来,Anthropic 在未来两三年锁定的算力规模已经逼近一个中等国家的电网尖峰。这种"多供应商、多架构、多地理位置"的组合很刻意——既规避单点依赖,也给不同任务匹配合适芯片:训练用 NVIDIA,推理用 Trainium 和 TPU,突发容量靠租赁。

和 OpenAI 深度绑定微软、xAI 深度绑定自家 SpaceX 的打法相比,Anthropic 更像一个采购型玩家——谁家算力便宜、谁家档期合适就签谁。代价是协调成本高、供应链复杂,好处是不会被任何一家卡脖子。

一个务实的判断

抛开那些宏大叙事,这次合作对用户最实在的价值就一条:今天开始 Claude 能多跑一倍的活,而且不用涨价。

这在 AI 行业其实不常见。过去一年多,大模型厂商的主流动作是砍长上下文折扣、调高 Pro 档价格、把好模型挪到更贵的档位。Anthropic 这次反向操作,把新拿到的算力直接让利给付费用户,某种程度上说明两件事:

第一,Claude 付费用户的续费意愿和 NPS 对 Anthropic 非常重要,尤其是 Claude Code 这块已经是它在开发者市场扳回一城的关键产品,额度体验不能输。

第二,算力真的开始"过剩"了——至少对单个厂商的当期需求是这样。当你同时签下 10 GW 量级的未来产能,旧算力反而成了短期要消化的库存。租给 Anthropic 跑 Claude,对 SpaceX/xAI 是一笔利用率生意,对 Anthropic 是燃眉之急的补给,双赢。

AI 基础设施的叙事,已经从"谁能买到卡"过渡到了"谁能把闲置算力盘活"。这次 Colossus 1 的转手,是这个阶段最具代表性的一笔交易。

参考来源

- IT之家:SpaceX 向 Anthropic 开放 Colossus 1 使用权,包含超 22 万颗英伟达 GPU —— 合作公告与 GPU 规格的中文首发报道

- Linux.do:Claude 和 SpaceX 达成算力合作,所有付费套餐五小时窗口翻倍 —— 宝玉老师整理的限额变化解读与背景脉络