5 月 7 日,阿里千问在 PC 端悄悄上线了一项新能力:AI 语音输入。没有发布会,没有铺天盖地的宣传片,一个快捷键,一条更新日志,功能就这么全量开放了,所有用户免费用。

但这东西如果只当成"语音打字"来看,基本等于白上线。它的野心明显不止于此。

一个被藏在"输入法"名字里的任务调度器

先看千问这次给出的两组快捷键设计,很能说明产品团队在想什么:

- 按住快捷键(Windows 是右 Alt,Mac 是右 Command,支持自定义):进入语音输入模式。说一段话,系统自动去掉"嗯"、"那个"、"就是"这些口语冗余,纠正口误,按语义断句,把一串语音流整理成结构化的文本,直接落到当前光标所在的输入框里。

- 双击快捷键:切到 AI 指令模式。这时你说的不是要被写下来的内容,而是要让 AI 去做的事——检索信息、起草邮件回复、翻译一段文档、生成一份会议纪要,都可以。

差别看起来只是"按住"和"双击",背后逻辑完全是两件事。前者是把语音翻译成文字,后者是把语音翻译成任务。

这也解释了为什么叫"千问语音输入法"这个名字有点误导——用户第一反应会拿它跟讯飞输入法、搜狗语音的那一套比。但实际体验下来,它更像是一个被伪装成输入法的 AI 入口,借输入法这个形态,绕过了"必须打开千问客户端"这道门槛。

为什么要做成"跨应用"的?

过去一年,国内外 AI 助手的一个共同困境是:用户得切换上下文。你在写文档,想让 AI 改一段话,得复制出来,打开 ChatGPT 或者千问网页版,贴进去,生成,再复制回来,粘贴。这套流程走一遍,灵感都凉了。

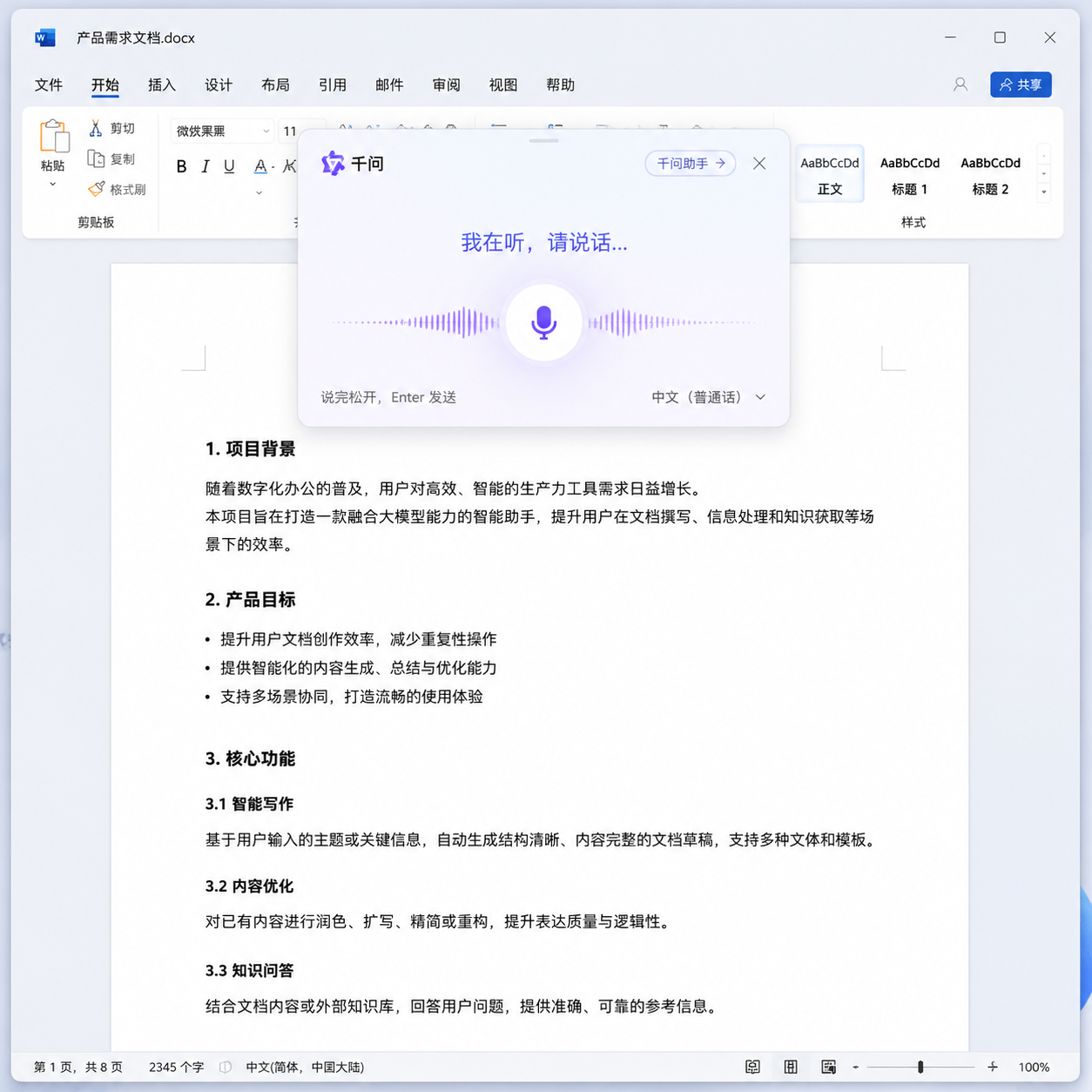

千问这次的解法是把 AI 嵌到系统层面。不管你当前在 Word、飞书文档、Chrome、微信还是 VS Code,按一下快捷键,一个浮层弹出来,说完话,结果直接插到你要的位置。整个过程不需要跳应用。

这思路其实跟 macOS 上那个火过一阵的 Wispr Flow,还有更早的 Raycast AI 是一路的:不做独立的 AI 应用,做系统级的 AI 快捷入口。区别是 Wispr Flow 在中文场景下识别和整理能力一直差点意思,而千问这边,中文语料和语言模型本来就是自家的主场。

"去口语化"这件事,比想象中重要

如果你用过任何语音转文字工具就知道,原始转写的东西基本不能直接用。人说话是带噪音的——"嗯那个我觉得吧这个事情呢其实是这样的",转成文字就是一坨垃圾。大部分工具止步于此,留给用户自己手动清理。

千问语音输入法默认就会做三件事:

- 去语气词:嗯、啊、就是、那个、对吧,这类冗余直接清掉

- 纠错:同音字、口误、漏字根据上下文补齐修正

- 格式化:长段落自动断句,列举内容自动转成条目,代码片段保留结构

对开发者来说最实用的场景可能是写注释、写 commit message、写技术文档。一边盯着代码一边口述逻辑,比键盘敲得快得多,而且不用反复切换中英文。之前我自己用讯飞+手动整理的流程,一段 300 字的技术描述至少要改两遍,现在基本可以一次过。

指令模式能干什么

双击快捷键进入指令模式之后,语音不再是"要写的内容",而是"要做的事"。几个典型场景:

- 在 Chrome 里看一篇英文论文,双击快捷键:"帮我总结这篇文章的三个核心贡献"——结果直接显示在浮层里

- 在微信里收到一条消息,不想打字,双击:"用专业一点的语气回复他说我周四下午有空"——生成好的文本可以一键发送

- 写代码时卡住了:双击:"给我一段 Python 的异步 HTTP 请求池实现,带超时重试"——代码段直接插入编辑器

- 写周报:双击:"根据我这周的 Git 提交记录生成周报初稿"——接入本地上下文后自动整理

这里的关键在于,指令模式做的是意图理解,不是关键词匹配。你不需要学特定的唤醒词或者指令格式,用大白话说就行。模型会自己判断你是要检索、要生成、要翻译,还是要改写。

跟谁在抢市场?

这一块现在挺热闹。把能放到一起对比的产品列一下:

| 产品 | 形态 | 中文能力 | AI 指令 |

|---|---|---|---|

| 千问语音输入法 | 系统级浮层 | 强 | 原生支持 |

| 讯飞输入法 | 传统输入法+AI | 强 | 需切换 AI 助手 |

| 搜狗输入法 | 传统输入法 | 强 | 基础对话 |

| Wispr Flow | 系统级浮层 | 一般 | 支持但以英文为主 |

| Raycast AI | 启动器 | 中文一般 | 强 |

千问的打法是"系统级浮层 + 强中文 + 原生 AI 指令"三者合一。短期内,这个生态位在国内 PC 端几乎没有对手。讯飞的 AI 助手是加装式的,打开流程比千问多两步;Raycast 在国内网络和中文语料上都有劣势;Wispr Flow 是纯海外产品。

当然,要说问题也有。目前千问指令模式的任务完成度,很大程度上取决于应用有没有做适配——能不能读到当前页面内容、能不能把结果回写进去。这套能力往后走,本质上是一个类似 MCP(Model Context Protocol)的协议问题。千问如果真想把这个做成"AI 任务调度中枢",下一步大概率要开放给第三方应用接入。

一点判断

语音作为 AI 的主要输入方式,被预言了很多年。但在 PC 上,它一直没真正起来,原因是传统语音输入的产出不够好——转写质量差、整理麻烦、还得切工具——导致键盘始终更高效。

大模型改变了这个天平。当语音不再只是"转文字",而是"转意图",键盘在某些任务上就开始处于劣势了。尤其是那些本来就需要"想清楚再写"的任务:邮件、文档、总结、提问。口述的速度是打字的 3 倍,而 AI 正好能补上口述不够精炼这块短板。

千问这次的上线,在产品形态上不算首创,但放在国内 PC 端的中文场景里,目前是完成度最高的一个。而且它免费、全量开放、不用注册复杂账号——这个门槛低到几乎没有理由不装一个试试。

真正值得关注的是再往后的演进:指令模式能不能接入更多应用上下文?能不能跟本地文件、浏览器标签页、IDE 里的项目打通?这些做到了,"用嘴干活"才算真正成立。否则它还是一个更好用的语音输入法,不是 AI 操作系统的雏形。

从今天这个版本看,千问团队明显是奔着后者去的。

参考来源

- IT之家:用嘴干活,阿里千问 PC 端上线 AI 语音输入功能 — 功能细节、快捷键设计和使用场景的原始报道

- 知乎专栏:10 款 AI 语音输入神器推荐 — 市场上同类产品的横向参考