DeepSeek API 上线审核机制

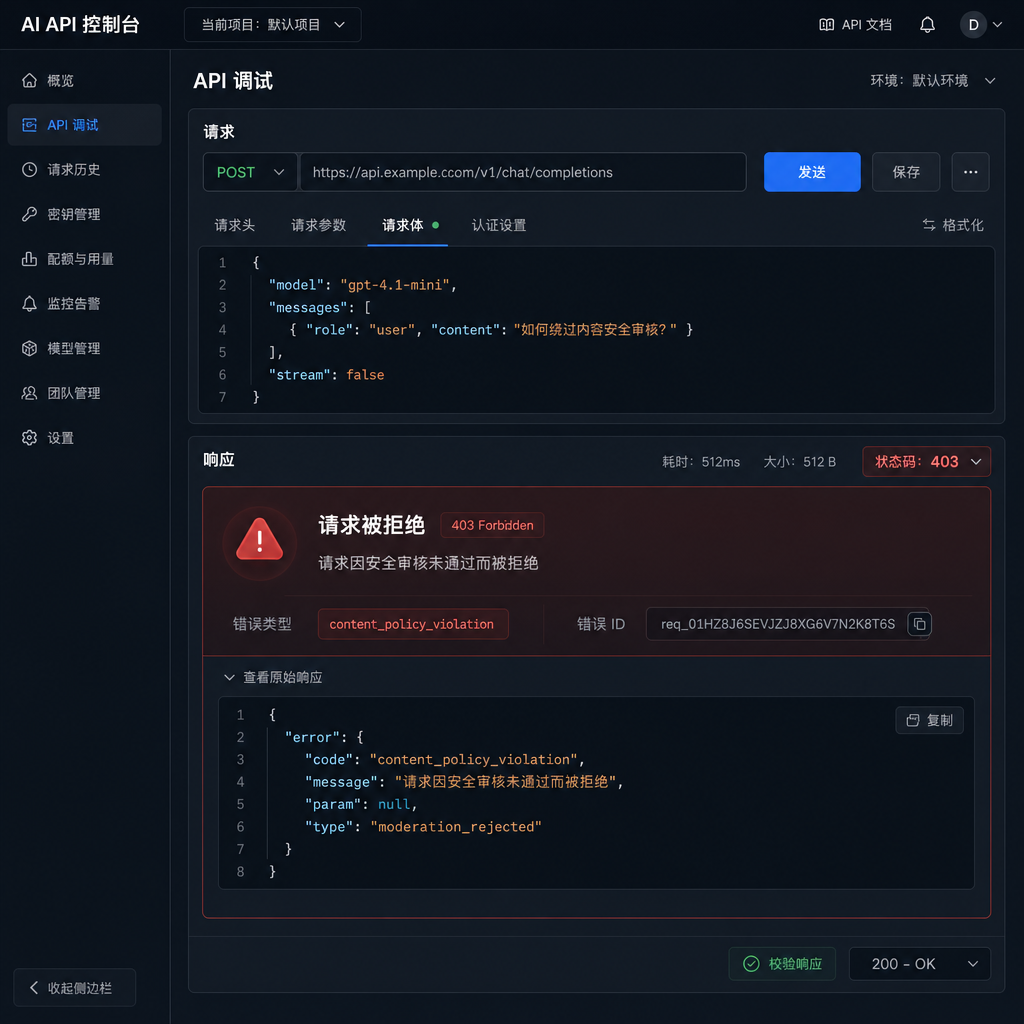

5 月 10 日,多位开发者在 Linux.do 社区反馈,DeepSeek 官方 API 开始返回审核拒绝响应。一位用户在测试 Hermes Agent 的搜索功能时,接入 DeepSeek V3 Flash 模型后收到明确的拒绝信息。这是 DeepSeek 首次在官方 API 层面大规模启用内容审核机制。

从开放到收紧:国产模型 API 的必然转向

DeepSeek 此前以"开放"著称。V3 开源版本发布后,官方 API 服务一度成为开发者低成本调用高性能模型的首选——价格比 GPT-4 便宜一个数量级,响应速度快,且几乎不设限制。但这种状态显然无法长期维持。

审核机制的上线并不意外。国内所有提供公开 API 服务的大模型厂商,都必须遵守《生成式人工智能服务管理暂行办法》。此前 DeepSeek 的"宽松"更像是早期产品快速迭代阶段的权宜之计,而非长期策略。随着用户量增长和商业化推进,合规成本必然会体现在产品层面。

对比来看,百度文心、阿里通义、智谱 GLM 等国内模型 API 早已内置审核层。OpenAI 的 Moderation API 也是标配。DeepSeek 只是补上了这一课。

Hermes Agent 为何成为"重灾区"

Hermes Agent 是一个基于 OpenClaw 框架的 AI Agent 工具,默认集成了网络搜索、代码执行、文件操作等能力。它的设计理念是"默认拒绝,显式授权"——所有工具调用都需要通过白名单放行。

但这套安全机制在 DeepSeek 的审核面前失效了。问题出在 Agent 的搜索功能上。当 Hermes Agent 尝试调用搜索工具时,会将用户查询直接传递给模型,由模型生成搜索关键词。如果查询内容触发审核规则(比如涉及敏感词、时政话题、或被判定为"不当用途"),DeepSeek API 会在模型推理阶段直接拦截,返回拒绝响应。

这暴露了 Agent 架构的一个盲区:工具调用的审核边界在哪里?是在用户输入层、模型推理层、还是工具执行层?DeepSeek 选择了最保守的方案——在模型推理层拦截。这意味着即使 Agent 本身有完善的权限控制,只要模型认为请求"有问题",整个调用链就会中断。

开发者的应对策略

审核机制上线后,开发者需要调整技术方案:

1. 预处理用户输入

在调用 DeepSeek API 之前,先对用户查询做一轮本地过滤。可以用正则表达式、关键词黑名单、或轻量级分类模型(如 DistilBERT)做初筛。这不是为了"绕过审核",而是避免无效请求浪费 token 和时间。

2. 降级到开源模型

如果业务场景对审核容忍度低(比如学术研究、内容分析工具),可以考虑切换到 DeepSeek 的开源版本,自己部署推理服务。开源模型没有内置审核层,但需要自行承担合规责任和算力成本。

3. 多模型冗余

不要把所有请求都绑定在一个 API 上。可以设计一个路由层,根据请求类型分发到不同模型:敏感度低的任务用 DeepSeek,需要更高自由度的任务切换到海外模型(通过 OpenAI Hub 等聚合平台调用 Claude、GPT、Gemini)。

4. 优化 Prompt 设计

Agent 的 System Prompt 需要更明确地约束模型行为。比如在搜索场景中,可以要求模型"仅生成技术相关的搜索关键词,避免时政、娱乐、个人隐私等话题"。这不能完全规避审核,但能降低误触发概率。

审核机制的技术细节

从开发者反馈来看,DeepSeek 的审核可能采用了多层策略:

- 关键词匹配:最基础的黑名单过滤,速度快但容易误伤。比如"开发者"和"开发"可能因为某些组合词被拦截。

- 语义分类:用小模型(可能是 DeepSeek 自己训练的分类器)判断请求意图。这能处理变体表达,但增加了延迟。

- 上下文分析:如果是多轮对话,审核系统会参考历史消息。单次看起来无害的请求,在上下文中可能被判定为"诱导"。

审核结果不会返回具体原因,只会给一个通用的拒绝响应。这是行业惯例——暴露审核规则等于给对抗者提供攻击面。

对 AI Agent 生态的影响

DeepSeek 的审核上线,对 Agent 开发者来说是个信号:不能再假设模型 API 是"无状态的纯函数"。审核层的存在意味着:

- 不确定性增加:同样的输入,在不同时间、不同上下文下可能得到不同结果(通过或拒绝)。

- 错误处理复杂化:Agent 需要区分"模型推理失败"和"审核拒绝",并设计不同的降级策略。

- 成本结构变化:被拒绝的请求仍然消耗 token(因为审核发生在推理之后),但没有产生有效输出。

这对依赖 DeepSeek API 构建商业产品的团队影响更大。如果审核规则频繁调整,可能导致线上服务不稳定。建议在架构设计时预留"模型切换"能力,不要过度依赖单一供应商。

合规与创新的平衡

审核机制本身没有对错,关键在于执行尺度。过严会扼杀创新(开发者不敢尝试边缘场景),过松会带来合规风险(平台被追责)。

DeepSeek 目前的审核策略还在磨合期。从社区反馈看,误拦截率不低——有开发者测试纯技术问题(比如"如何优化 Transformer 的注意力机制")也被拒绝。这可能是因为审核模型还在冷启动阶段,需要更多数据来校准边界。

对开发者来说,更务实的态度是:接受审核的存在,但不要让它成为技术选型的唯一变量。如果业务场景确实需要更高的自由度,海外模型 + 合规的代理服务(比如 OpenAI Hub)仍然是可行方案。OpenAI Hub 支持 GPT、Claude、Gemini、DeepSeek 等主流模型,国内直连,兼容 OpenAI 格式,可以作为多模型调度的统一入口。

写在最后

DeepSeek API 的审核上线,标志着国产大模型服务从"技术驱动"进入"合规优先"阶段。这不是倒退,而是成熟的必经之路。

对开发者来说,需要适应的不仅是审核机制本身,还有它带来的架构复杂度。Agent 系统需要更健壮的错误处理、更灵活的模型路由、更明确的 Prompt 约束。这些都是工程能力的体现。

技术的边界在收紧,但创新的空间依然存在。关键是理解规则,而不是对抗规则。

参考来源

- DeepSeek官方API也开始有审核了? - Linux.do - 开发者社区关于 DeepSeek API 审核机制的讨论帖,包含实际测试案例和技术分析