VS Code Copilot 终于能接第三方模型了

GitHub Copilot 的模型选择一直是个槽点——官方只给 GPT-4o、Claude 3.5 Sonnet 这几个选项,想用 DeepSeek、Qwen 或者自己的 API 中转?没门。但最近社区出现了几个能绕过这个限制的插件,已经有开发者在公益 API 站上跑通了。

这不是第一次有人尝试破解 Copilot 的模型限制,但这次不一样的是:多个独立开发者用不同技术路线都成功了,而且已经有可用的插件发布到 VS Code 市场。

技术路线:三种方案殊途同归

目前社区验证过的方案主要有三种,核心思路都是拦截 Copilot 的 API 请求并重定向到自定义端点。

方案一:修改 Copilot Chat 源码

直接改 Copilot Chat 扩展的 JavaScript 代码,在模型选择器里硬编码新的提供商选项。这种方法最直接,但每次 Copilot 更新都得重新改一遍,而且理论上违反了扩展的使用协议。有开发者在 CSDN 上分享过详细步骤,但这个方法的维护成本太高,不适合长期使用。

方案二:API 兼容层封装

把 OpenAI 兼容的 API 伪装成 Ollama 的本地服务。Copilot 原生支持 Ollama,所以只要让你的 API 中转服务返回 Ollama 格式的响应,Copilot 就会认为这是本地模型。

这个方案的优势是不需要动 Copilot 本体,但问题在于 Ollama 的协议和 OpenAI 有些细节差异,比如流式响应的格式、错误处理机制等。实际测试中发现,某些模型的 thinking token(思考链输出)在这种封装下会丢失,影响推理类任务的效果。

方案三:独立扩展拦截请求

最近在 Linux.do 论坛引起关注的就是这种方案。开发者写了一个独立的 VS Code 扩展,通过 VS Code 的扩展 API 拦截 Copilot 的网络请求,然后把请求转发到自定义的 API 端点。

这个方案的技术难点在于:Copilot 的请求不是标准的 OpenAI 格式,而是 GitHub 自己魔改过的协议。比如认证机制用的是 GitHub 的 OAuth token,请求头里有特殊的 X-GitHub-Api-Version 字段,响应格式也有微调。

更麻烦的是,一些公益 API 站(比如帖子里提到的 any route 和 agent router)会检测请求是否来自 Claude Code CLI——这是 Anthropic 官方的命令行工具,某些站点只允许这个客户端调用 Opus 模型。开发者通过抓包分析出了验证逻辑,然后在扩展里伪造了对应的请求头和 User-Agent,成功绕过了检测。

实测:已经能用,但体验参差不齐

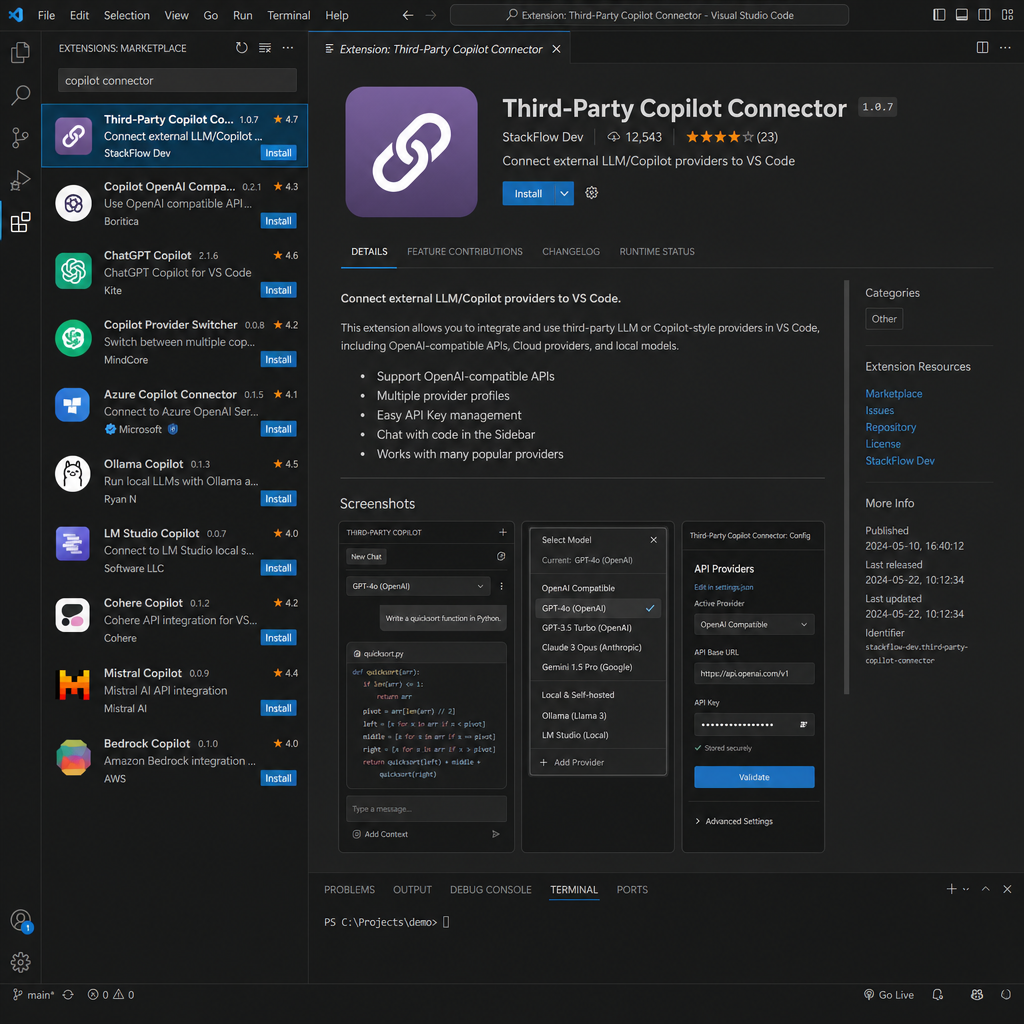

目前在 VS Code 市场能找到的插件主要是 OAI Compatible Provider for Copilot。配置方法很直接:

- 在扩展设置里填入 API 端点和 Key

- 配置模型列表(支持自定义 displayName、max_tokens、temperature 等参数)

- 重启 VS Code,在 Copilot Chat 的模型选择器里就能看到新模型

实际测试中发现几个问题:

延迟和稳定性

公益站的响应速度本来就不稳定,再加上多一层转发,首 token 延迟经常超过 3 秒。如果用的是海外 API 中转,网络波动会导致请求超时,Copilot 会直接报错而不是优雅降级。

上下文管理

某些模型(尤其是开源模型)对长上下文的处理不如 GPT-4o。在多轮对话中,Copilot 会把之前的代码片段、错误信息全部塞进 prompt,很容易超出模型的 context window。插件虽然支持配置 max_tokens,但 Copilot 本身的 prompt 构造逻辑是黑盒,你没法精确控制实际发送的 token 数。

功能缺失

视觉功能(vision)在某些模型上不可用。即使你在配置里把 vision 设为 true,Copilot 也不一定会发送图片数据——这取决于模型 ID 是否在 Copilot 的白名单里。有开发者尝试把自定义模型的 ID 改成 gpt-4-vision-preview,结果 Copilot 直接拒绝请求,提示"模型不可用"。

思考链(thinking)支持

对于支持 reasoning 的模型(比如 DeepSeek-R1、o1 系列),插件提供了 thinking_budget 参数来控制思考链的长度。但实测发现,Copilot 的 UI 并不会显示思考过程,只会在最终回复里看到结果。这对调试推理任务很不友好——你不知道模型是怎么得出结论的,也没法判断是推理出错还是 prompt 有问题。

为什么 GitHub 不官方支持?

技术上完全可行,为什么 GitHub 不直接开放自定义模型接入?

商业原因最直接

Copilot 的定价是 $10/月或 $100/年,这个价格覆盖了 GitHub 向 OpenAI、Anthropic 支付的 API 成本。如果允许用户接入自己的 API,尤其是免费的公益站或者便宜的国产模型,GitHub 就没法从模型调用里赚钱了。

更关键的是,Copilot 不只是个聊天界面,它还包括代码补全、inline chat、workspace indexing 这些功能。这些功能的 prompt 工程是 GitHub 花了大量时间调优的,如果开放自定义模型,用户体验会变得不可控——某些模型可能根本理解不了 Copilot 的 prompt 格式,导致生成的代码质量下降,最后用户会觉得是 Copilot 不好用。

安全和合规风险

Copilot 处理的是用户的代码,这些代码可能包含敏感信息、商业机密、甚至是未公开的漏洞。如果允许用户把代码发送到任意第三方 API,GitHub 就没法保证数据安全。虽然用户可以自己承担风险,但对企业客户来说,这是个合规问题——很多公司的安全政策明确禁止把代码发送到未经审计的外部服务。

模型质量参差不齐

GitHub 选择的模型都是经过验证的,代码能力、安全性、响应速度都有保障。如果开放自定义模型,用户可能会接入一些质量很差的模型,生成的代码可能有 bug、安全漏洞、甚至是恶意代码。虽然这是用户自己的选择,但最后背锅的还是 Copilot。

社区插件的未来:能活多久?

这些插件目前能用,但长期稳定性存疑。

官方可能会封堵

之前提到的 DeepSeek v4 for Copilot Chat 插件已经从市场下架了,原因不明。可能是开发者主动下架,也可能是 GitHub 或 Microsoft 要求下架。如果这类插件影响了 Copilot 的商业模式,官方完全有动力通过技术手段封堵——比如修改 API 协议、加强请求验证、或者直接在扩展审核时拒绝这类插件上架。

维护成本高

Copilot 的更新频率很高,几乎每个月都有新功能或协议调整。插件开发者需要持续跟进这些变化,否则插件就会失效。而且这些插件大多是个人项目,没有商业支持,一旦开发者失去兴趣或者没时间维护,插件就会变成废品。

API 站点的稳定性

公益 API 站本身就不稳定,随时可能关闭或者改变接入规则。比如帖子里提到的两个站点都有反爬虫机制,如果检测到异常流量或者滥用,可能会封禁 API Key。而且这些站点的模型配额通常有限,如果大量用户通过插件接入,很快就会耗尽配额。

对开发者的实际价值

抛开这些不确定性,这类插件对某些场景还是有价值的。

成本控制

如果你有自己的 API 中转服务,或者用的是按量付费的云服务商(比如阿里云、腾讯云的模型 API),通过插件接入可以显著降低成本。尤其是对于高频使用 Copilot 的开发者,官方的 $10/月可能不够用,但自己接入 API 可以按实际用量付费。

模型选择自由

Copilot 官方支持的模型有限,而且更新滞后。比如 DeepSeek-V3 发布后,Copilot 过了好几周才支持。如果你想第一时间用上新模型,或者想用某些特定领域优化过的模型(比如专门训练过的代码模型),插件是唯一的选择。

隐私和数据主权

对于不想把代码发送到 GitHub/OpenAI/Anthropic 服务器的开发者,可以通过插件接入本地部署的模型(比如 Ollama、vLLM)。虽然本地模型的能力比不上云端的大模型,但对于敏感项目或者离线开发场景,这是唯一可行的方案。

实验和调优

如果你在研究 prompt 工程或者模型微调,插件可以让你快速测试不同模型的效果。比如对比 GPT-4o 和 Claude 3.5 Sonnet 在某个特定任务上的表现,或者测试自己微调的模型是否比基座模型更好。

技术细节:配置参数详解

如果你想尝试这类插件,需要理解几个关键配置参数。

baseUrl 和认证

这是 API 端点的地址,必须是 OpenAI 兼容格式。大部分 API 中转服务都支持这个格式,但有些细节需要注意:

- 端点路径通常是

/v1/chat/completions,不要漏掉/v1 - 认证方式可能是 Bearer token 或者 API Key,需要在

headers里配置 - 某些服务商要求额外的请求头,比如

X-API-Version或者自定义的鉴权字段

模型配置

每个模型可以单独配置参数:

model: 模型 ID,必须和 API 端点支持的模型名称一致displayName: 在 Copilot 界面显示的名称,可以自定义max_tokens: 最大生成长度,建议设为 4096 或更高,避免回复被截断temperature: 控制随机性,代码生成建议用 0-0.3,创意写作用 0.7-1.0vision: 是否支持图片输入,但实际能否使用取决于 Copilot 的判断逻辑

性能优化

max_completion_tokens: OpenAI 新标准参数,优先级高于max_tokensfrequency_penalty: 减少重复内容,代码生成场景建议设为 0.1-0.3thinking_budget: 对于 reasoning 模型,控制思考链的长度,避免浪费 token

风险提示

使用这类插件需要注意几个风险:

数据泄露

你的代码会被发送到第三方 API 端点,如果这个端点不可信,可能会记录或泄露你的代码。公益站通常没有严格的隐私政策,不要用于商业项目或敏感代码。

账号安全

某些插件需要你提供 GitHub token 或者 Copilot 的认证信息,如果插件本身有恶意代码,可能会窃取你的凭证。只安装来源可信的插件,最好检查一下源码。

服务稳定性

API 中转服务可能随时失效,导致 Copilot 无法使用。建议保留官方模型作为备选,不要完全依赖第三方 API。

违反服务条款

这类插件可能违反了 GitHub Copilot 的使用条款,理论上 GitHub 有权封禁你的账号。虽然目前没有听说过因为使用插件被封号的案例,但风险依然存在。

写在最后

VS Code Copilot 接入第三方模型的技术路线已经被社区验证可行,但这更像是一个"民间破解"而不是官方支持的功能。对于个人开发者或者实验性项目,这是个有价值的工具;但对于企业用户或者生产环境,还是建议用官方支持的模型,避免不必要的风险。

GitHub 会不会官方支持自定义模型?短期内不太可能。但如果社区的呼声足够大,或者竞争对手(比如 Cursor、Codeium)提供了更灵活的模型选择,GitHub 可能会重新考虑这个功能。

目前来看,这些插件能用多久、会不会被封堵,都是未知数。如果你想尝试,建议尽早,说不定哪天就用不了了。

参考来源

- 一个在vscode copilot接入第三方api站模型的插件 - Linux.do - 开发者分享的插件开发经验和测试结果

- 在 VS Code 的 Copilot 中接入第三方模型 - 知乎 - 详细的配置教程和 API 调用示例

- GitHub Copilot 调用第三方模型API - CSDN - 三种技术方案的对比分析

- 接入第三方OpenAI 兼容模型到GitHub Copilot - CSDN - API 兼容层封装的实现细节