IBM 开源 Granite Embedding R2:97M 参数打败一众百M级对手

IBM 刚发布了 Granite Embedding Multilingual R2 系列向量模型,直接在 Hugging Face 上开源。这次最亮眼的是 97M 参数的小模型版本——在多语言 MTEB 检索基准测试(18 个任务)上拿到 59.6 分,比同级别最强的 multilingual-e5-small(50.9 分)高出 8.7 分,体积还只有对方的三分之一。

这个成绩放在百M级参数的开源多语言向量模型里是第一。更关键的是,它用的是 Apache 2.0 协议,商用没有任何限制。

技术路线:剪枝 + 蒸馏 + 对比学习

Granite Embedding R2 系列包含两个版本:311M 参数的完整版和 97M 参数的精简版。97M 版本不是从头训练的小模型,而是从 311M 版本通过模型剪枝(pruning)压缩而来,同时结合了知识蒸馏、对比微调和词表优化。

这套组合拳的效果是:在保持检索质量的前提下,把模型体积压到原来的三分之一,推理速度提升明显。对于需要在边缘设备或资源受限环境下部署向量检索的场景,这个权衡很实用。

模型的核心能力来自对比学习训练。IBM 用了大量的查询-文档对(query-passage pairs)和跨语言数据来微调,确保不同语言的查询和相关文档在向量空间里的距离足够近。这种训练方式在多语言检索场景下特别有效,因为它直接优化了跨语言的语义对齐。

支持 200+ 语言,重点优化 52 种

模型基于多语言预训练语料,理论上支持 200 多种语言。但 IBM 没有平均用力,而是对 52 种语言和编程代码做了专门的检索对训练和跨语言训练。这 52 种语言覆盖了全球主要市场,包括中文、日语、韩语、阿拉伯语、俄语等。

这种"重点优化"的策略在实际应用中更合理。大部分企业的多语言检索需求集中在几十种主流语言上,与其把资源分散到几百种长尾语言,不如把常用语言做到最好。

上下文窗口是 32K tokens。这个长度在向量模型里算是标配了,足够处理大部分文档检索场景。但要注意,向量模型的上下文窗口和生成模型不是一回事——它主要影响单次编码的文本长度上限,而不是对话历史长度。

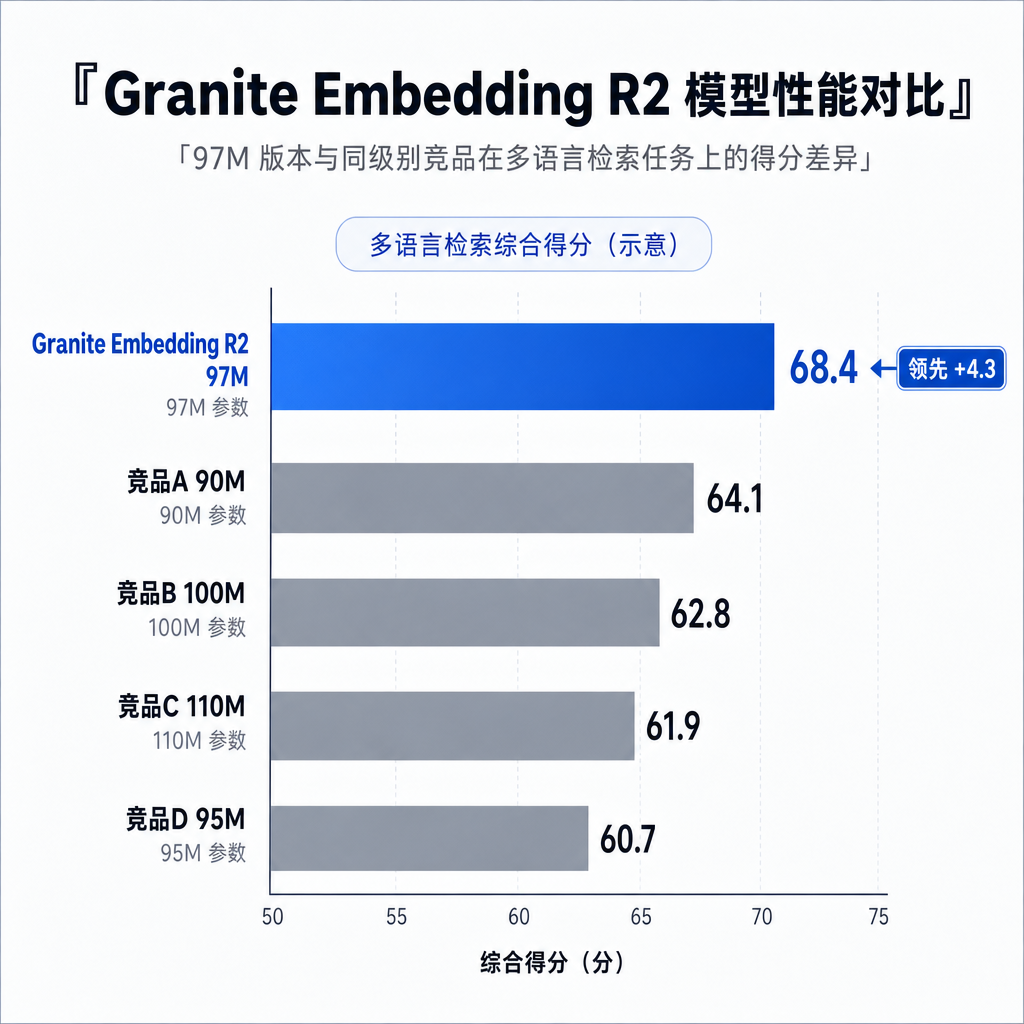

性能数据:小模型的逆袭

在多语言 MTEB 检索基准上,97M 版本的 59.6 分是什么概念?对比一下:

- multilingual-e5-small (118M 参数): 50.9 分

- multilingual-e5-base (278M 参数): 54.2 分

- Granite Embedding 97M R2: 59.6 分

- Granite Embedding 311M R2: 62.1 分

97M 版本不仅超过了同级别的 e5-small,甚至逼近了参数量是自己 3 倍的 e5-base。311M 完整版的 62.1 分则是目前开源多语言向量模型的顶级水平。

MTEB (Massive Text Embedding Benchmark) 是目前评估向量模型最权威的基准之一,包含检索、分类、聚类、语义相似度等多个维度。IBM 这次重点强调的是检索任务得分,因为这是 RAG 和语义搜索场景最核心的能力。

值得注意的是,这个成绩是在 18 个多语言检索任务上的平均值。不同语言、不同领域的表现会有差异,但整体趋势是:Granite Embedding R2 在资源受限的情况下,检索质量没有明显妥协。

实际应用场景

向量模型的主要用途是 RAG (Retrieval-Augmented Generation) 和语义搜索。具体来说:

跨语言文档检索: 用户用中文提问,系统能从英文、日文、德文的文档库里找到相关内容。这在跨国企业的知识库、多语言客服系统里是刚需。Granite Embedding R2 的跨语言训练让它在这个场景下比单语言模型更有优势。

代码语义搜索: 模型对编程代码做了专门优化,可以用自然语言描述功能,然后检索代码库里的相关实现。这对开发者来说很实用——不用记住具体的函数名或 API,描述一下想要的功能就能找到代码。

边缘设备部署: 97M 参数的体积让它可以跑在资源受限的环境里,比如移动端、IoT 设备、私有化部署的小型服务器。对于不想把数据传到云端的场景,本地部署一个轻量级向量模型是更安全的选择。

RAG 系统的召回层: 在多阶段检索系统里,通常会用轻量级模型做初筛(召回),再用重模型做精排。97M 版本可以作为召回层,快速从海量文档里筛选出候选集,然后交给 reranker 做最终排序。这种架构在保证效果的同时,能显著降低计算成本。

和其他开源方案的对比

OpenAI 的 text-embedding-3 系列、Cohere 的 embed-multilingual 都是闭源的,虽然效果好,但有 API 调用成本,数据也要传到第三方服务器。对于敏感数据或需要私有化部署的场景,开源模型是唯一选择。

在开源阵营里,Sentence-Transformers 生态的 multilingual-e5 系列一直是主流选择,但它用的是 MIT 协议,商用需要注意条款。BGE 系列(智源出品)在中文场景下表现不错,但多语言能力相对弱一些。

Granite Embedding R2 的优势在于:

- Apache 2.0 协议: 商用完全自由,不用担心授权问题

- 参数效率: 97M 参数达到甚至超过其他模型 200M+ 参数的效果

- 多语言平衡: 不是只优化英文或中文,而是在 52 种语言上都做了针对性训练

- IBM 背书: 企业级应用更看重模型的稳定性和长期维护,IBM 的品牌在这方面有优势

当然也有局限。向量模型的效果很大程度上取决于训练数据的领域分布。如果你的应用场景是医疗、法律等垂直领域,可能还需要在 Granite Embedding 的基础上做领域适配微调。

技术细节:怎么用

模型已经上传到 Hugging Face,可以直接用 sentence-transformers 或 transformers 库加载:

from sentence_transformers import SentenceTransformer

# 加载模型

model = SentenceTransformer('ibm-granite/granite-embedding-97m-multilingual-r2')

# 编码文本

queries = [\"如何优化数据库查询性能?\", \"How to optimize database queries?\"]

documents = [

\"数据库查询优化的关键是建立合适的索引\",

\"Use indexes to speed up database queries\",

\"缓存常用查询结果可以减少数据库负载\"

]

query_embeddings = model.encode(queries)

doc_embeddings = model.encode(documents)

# 计算相似度

from sentence_transformers.util import cos_sim

scores = cos_sim(query_embeddings, doc_embeddings)

print(scores)

如果用 transformers 库,需要手动处理 mean pooling:

from transformers import AutoTokenizer, AutoModel

import torch

tokenizer = AutoTokenizer.from_pretrained('ibm-granite/granite-embedding-97m-multilingual-r2')

model = AutoModel.from_pretrained('ibm-granite/granite-embedding-97m-multilingual-r2')

def encode(texts):

inputs = tokenizer(texts, padding=True, truncation=True, return_tensors='pt', max_length=512)

with torch.no_grad():

outputs = model(**inputs)

# Mean pooling

embeddings = outputs.last_hidden_state.mean(dim=1)

return embeddings

embeddings = encode([\"测试文本\", \"test text\"])

模型输出的是 768 维的向量。在实际部署时,可以考虑用 FAISS、Milvus 等向量数据库来存储和检索这些向量,支持百万甚至亿级规模的文档检索。

开源生态的又一块拼图

IBM 这两年在开源 AI 上动作频繁。去年开源了 Granite 系列语言模型,现在又补上了向量模型这一块。从模型架构到训练数据,IBM 都选择了透明化——模型卡片里详细列出了训练数据来源、评估方法、已知局限性。

这种透明度在企业级应用里很重要。很多公司在选型时,不仅要看模型效果,还要评估数据合规性、模型可解释性、长期维护风险。开源模型在这些方面比闭源 API 更有优势,前提是有靠谱的团队在背后持续维护。

Granite Embedding R2 的发布,让开源向量模型在多语言场景下有了更强的竞争力。对于需要私有化部署、对数据安全有严格要求、或者想要在边缘设备上跑向量检索的团队来说,这是一个值得考虑的选择。

97M 参数能打赢 118M 甚至逼近 278M 的对手,说明模型压缩和知识蒸馏的技术路线在向量模型上同样有效。未来可能会看到更多"小而美"的向量模型——不追求参数规模,而是在特定场景下做到效率和效果的最佳平衡。

参考来源

- Granite Embedding Multilingual R2 官方博客 - IBM 官方技术解读,包含详细的训练方法和评估结果

- granite-embedding-97m-multilingual-r2 模型页面 - Hugging Face 模型卡片,包含使用示例和技术规格

- Granite Embedding 模型集合 - IBM Granite Embedding 系列的完整模型列表